Быстрый старт для ваших AI-приложений

Разверните готовую к работе векторную базу данных за минуты. Ускорьте вывод ваших RAG-агентов, ботов и рекомендательных систем на рынок.

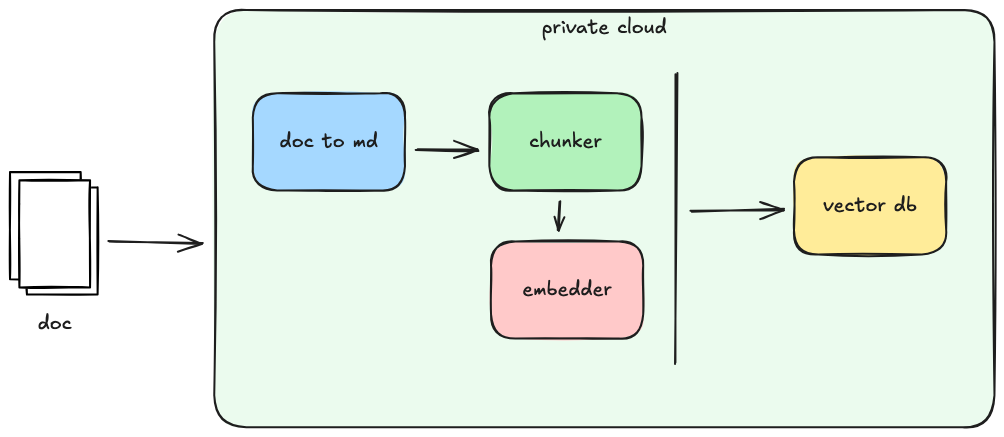

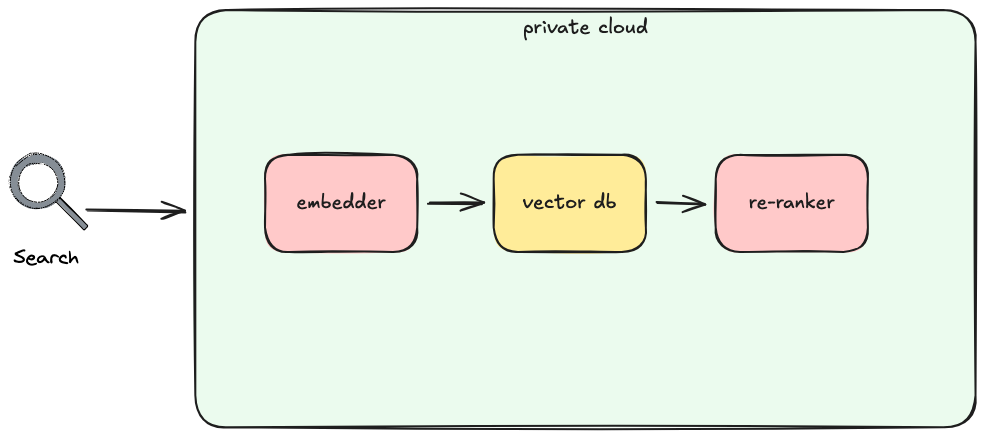

Создайте надежную основу для ваших RAG-приложений. Быстро, безопасно и полностью совместимо с экосистемой OpenAI.

Платформа exlnt.ai устанавливается в ваш контур и выступает в роли единого шлюза для всех LLM-сервисов. Это позволяет применять сквозные политики безопасности, контролировать расходы и упрощать разработку AI-приложений.

Платформа exlnt.ai устанавливается в ваш контур и выступает в роли единого шлюза для всех LLM-сервисов. Это позволяет применять сквозные политики безопасности, контролировать расходы и упрощать разработку AI-приложений.

Наша платформа полностью совместима с OpenAI Assistants API. Если вы уже используете их инструменты, вам достаточно изменить только базовый URL для API-клиента, чтобы начать работать с нами.

# Укажите адрес нашего шлюза в параметре base_url

# from openai import OpenAI

# client = OpenAI(base_url="https://your-exlnt-gateway.com/v1")

from openai import OpenAI

# Для примера используется стандартный клиент OpenAI

client = OpenAI()

# Создаем векторное хранилище для ваших документов

vector_store = client.beta.vector_stores.create(

name="Справочник сотрудника"

)

print(f"ID векторного хранилища: {vector_store.id}")# Укажите пути к вашим файлам

file_paths = ["employee_handbook.pdf"]

file_streams = [open(path, "rb") for path in file_paths]

# Загружаем файлы в созданное хранилище

file_batch = client.beta.vector_stores.file_batches.upload_and_poll(

vector_store_id=vector_store.id,

files=file_streams

)

# Важно закрыть файловые потоки после загрузки

for fs in file_streams:

fs.close()

print(f"Статус загрузки: {file_batch.status}")

print(f"Количество файлов: {file_batch.file_counts}")# Создаем Ассистента, который будет использовать наше хранилище

assistant = client.beta.assistants.create(

name="Помощник по справочнику",

model="gpt-4o",

tools=[{"type": "file_search"}],

tool_resources={"file_search": {"vector_store_ids": [vector_store.id]}},

)

# Создаем диалог (thread) и добавляем сообщение от пользователя

thread = client.beta.threads.create(

messages=[{

"role": "user",

"content": "Какие в компании правила насчет удаленной работы?"

}]

)

# Запускаем ассистента для обработки диалога

run = client.beta.threads.runs.create_and_poll(

thread_id=thread.id,

assistant_id=assistant.id

)

# Получаем и выводим ответ ассистента

if run.status == 'completed':

messages = client.beta.threads.messages.list(thread_id=thread.id)

# Ответ обычно является первым сообщением в списке

response_content = messages.data[0].content[0].text.value

print(response_content)

else:

print(f"Статус выполнения: {run.status}")Загрузите данные базы знаний в векторное хранилище и получите доступ к ним через агента, который будет строить свои ответы на основе загруженных данных.

Анализируйте большие объемы текстовых данных, отчетов и документов из архивов, автоматически извлекая нужную информацию и защищая коммерческую тайну.

Вы сможете с легкостью реализовать семантический поиск данных в инструкциях, регламентах и даже в описаниях товаров на вашем сайте.

Узнайте, как платформа exlnt.ai может помочь вашей организации получить полный контроль над использованием больших языковых моделей.